La question des données en Bio-Informatique

Résumé de section

-

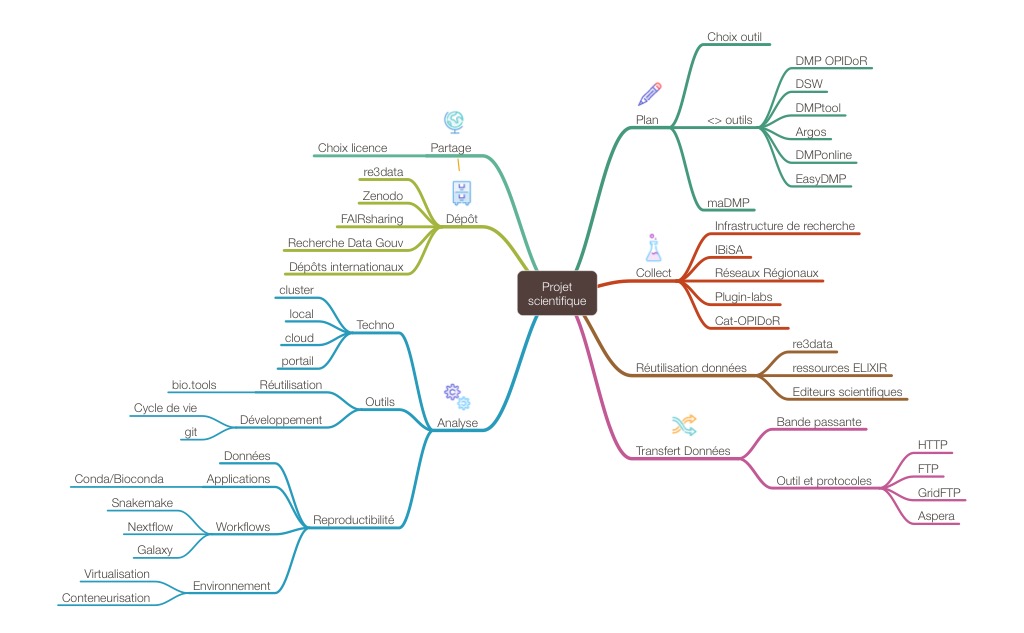

L'objectif de ce cours est de présenter les différentes étapes associées à la gestion de la donnée scientifique dans les champs de la Biologie et de la Bio-informatique. On abordera ces étapes sous l'angle technique tout en considérant les perspectives de science ouverte et de données FAIR qu'il est indispensable d'intégrer dans sa démarche.

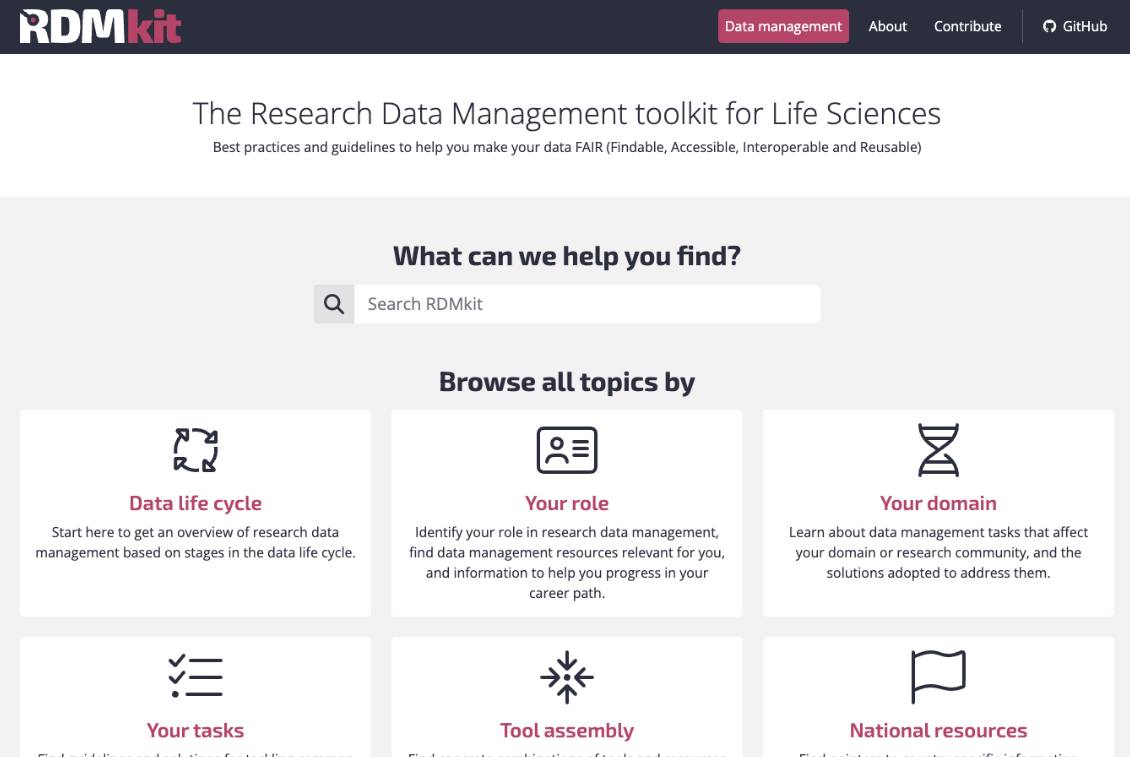

En Bio-Informatique, les données sont indissociables des logiciels utilisés pour leur traitement et leur analyse.

Ce support brossera le paysage actuel en France, proposera des éléments de réflexion et fournira des pointeurs vers des ressources utiles ou indispensables. Certains points techniques, notamment concernant les aspects informatiques, seront rapidement abordés afin de permettre de disposer des clés d'analyse de la situation.

Objectifs

- Comprendre la question de la donnée en Sciences du Vivant.

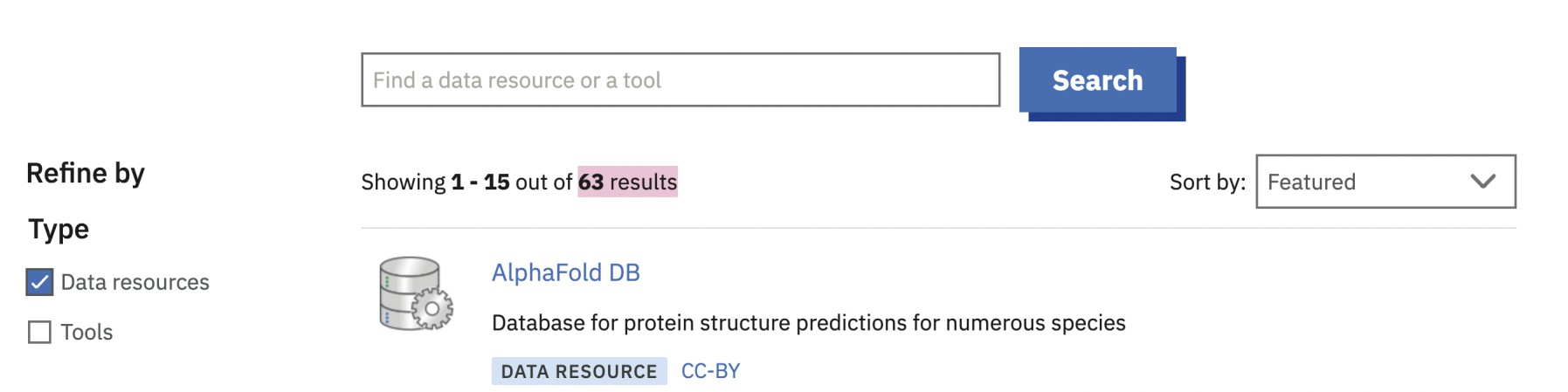

- Avoir une vision d’ensemble du paysage des infrastructures dédiées à la donnée.

- Identifier les verrous technologiques.

- Obtenir des pistes concernant des solutions technologiques.

Ce cours est en libre accès !

Aucune création de compte ou d'inscription n'est nécessaire, toutefois vous ne pourrez le parcourir qu'en lecture seule.

Pour échanger sur le forum, vous devrez vous inscrire au cours.

S'inscrire au cours -

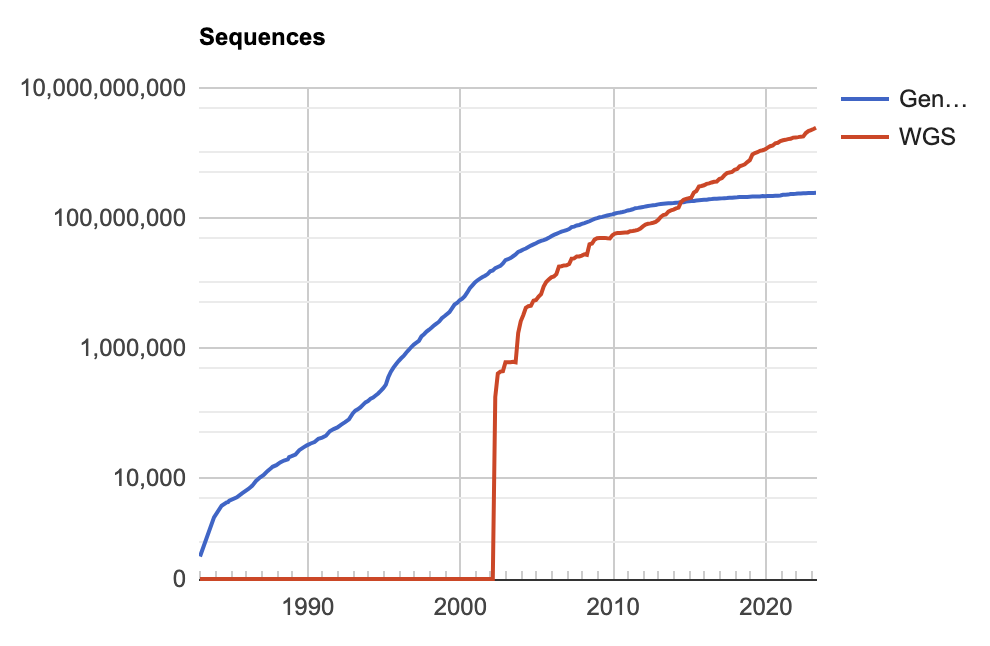

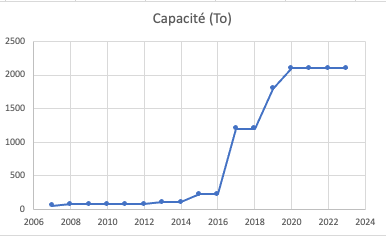

Les données biologiques sont souvent très volumineuses et complexes, et leur analyse nécessite des méthodes et des outils informatiques sophistiqués pour extraire des informations utiles. Elles sont aussi hétérogènes et proviennent de différentes sources, ce qui nécessite des méthodes pour les intégrer et les analyser de manière cohérente.

-

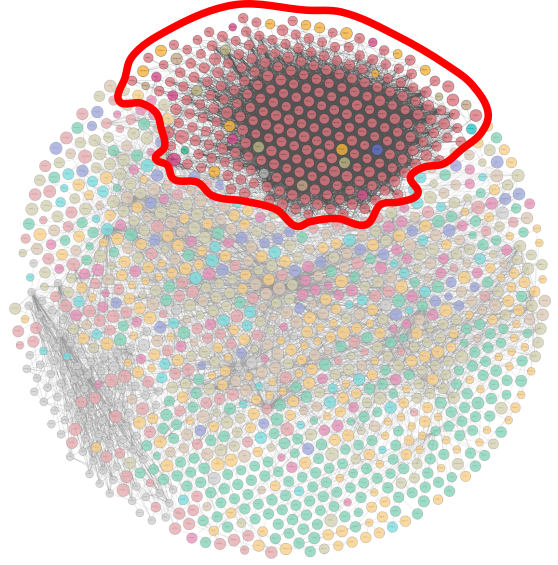

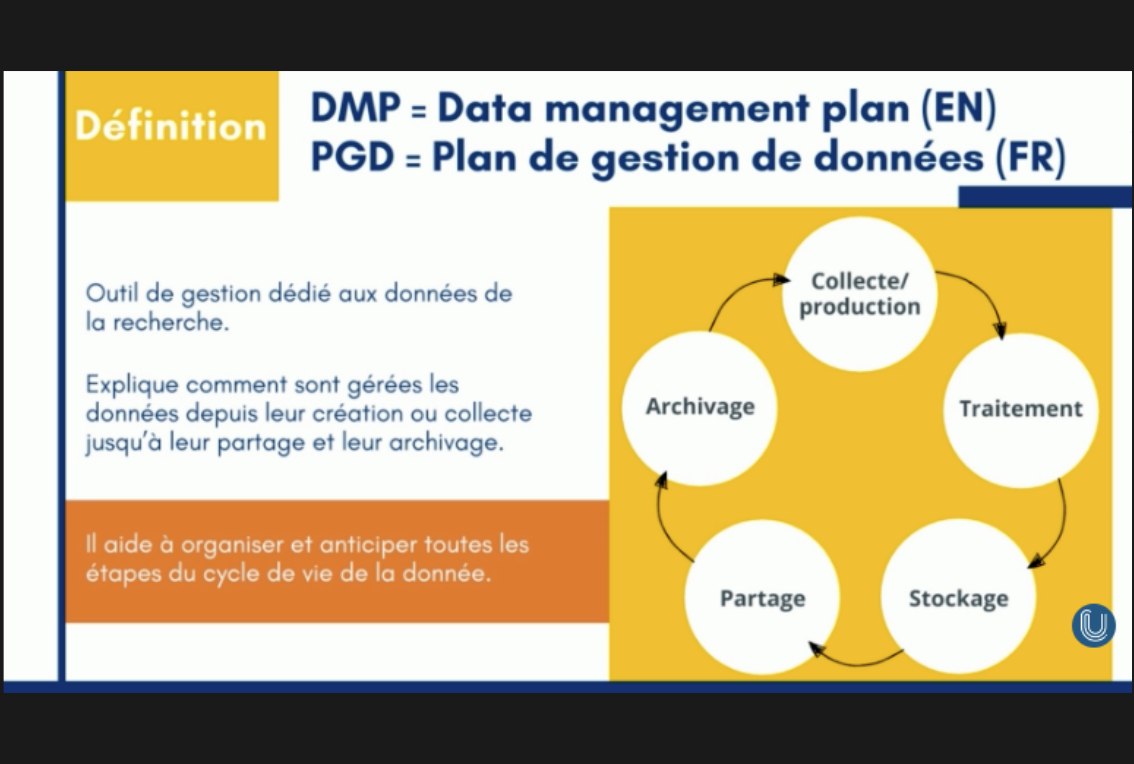

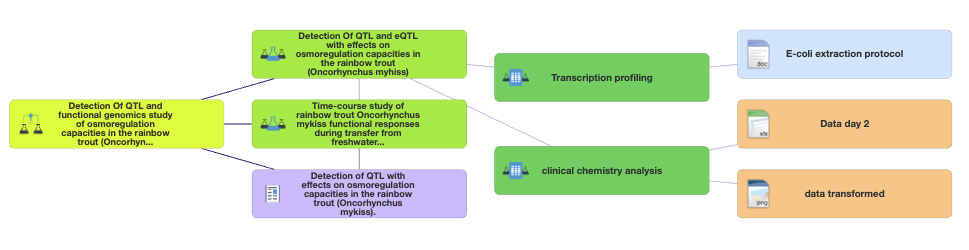

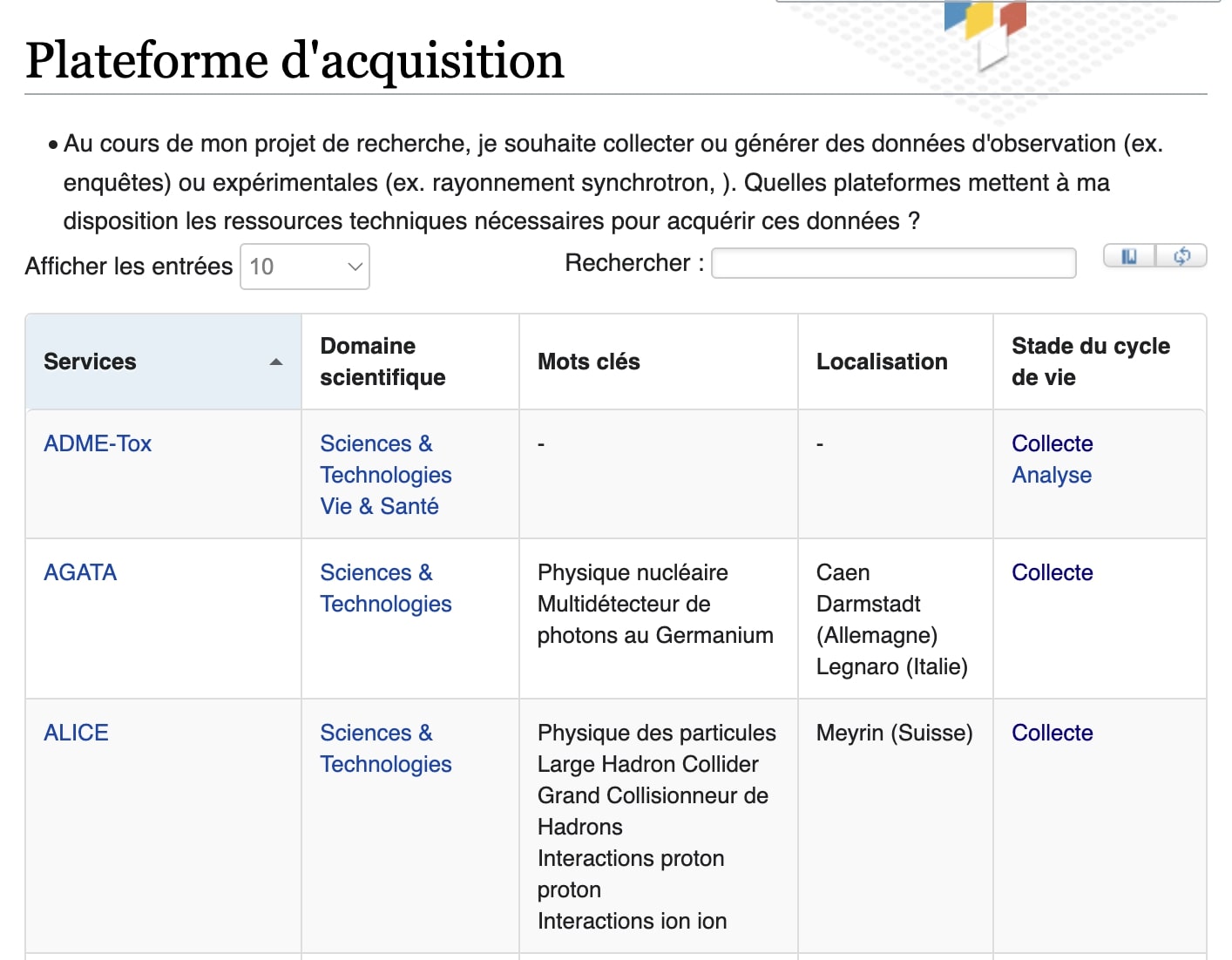

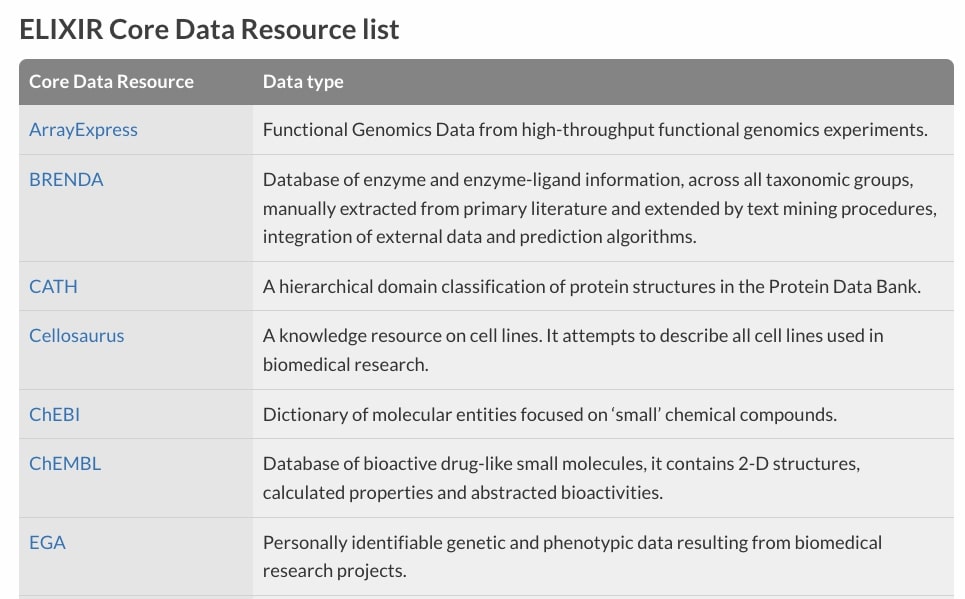

Dans le cadre de la structuration des projets de recherche, la gestion des flux de données en Biologie et en Bio-Informatique est un enjeu majeur pour les chercheurs qui devront mettre en place une organisation allant de la génération des données jusqu'à leur pérennisation, en passant par leur analyse. Dans un tel objectif, l'identification des infrastructures de génération, d'analyse et de pérennisation des données mais également l'adoption de bonnes pratiques de gestion de données est essentielle.

-

Cette section aborde la question de la gestion des données en Biologie et en Bio-Informatique, de leur génération à leur réutilisation. Elle traite des défis liés aux formats, au stockage, aux licences et aux transferts de données, mettant en avant les pratiques et les solutions pour une gestion optimale des données scientifiques.

-

Reposant sur l'utilisation de logiciels, au sein de divers environnements, cette étape va permettre de "faire parler les données". Ce passage de la donnée brute à l'information est une des étapes clés de la Bio-Informatique. Étant pratiquée in silico, elle doit être menée avec rigueur afin de pouvoir être reproductible.

-

Cette section met l'accent sur les principes fondamentaux de préservation, garantissant l'intégrité, la lisibilité et la réutilisabilité des données. Le partage des données est abordé, y compris les licences et les ressources pour faciliter ce processus. Des conseils sont donnés pour choisir des licences appropriées et des ressources sont fournies pour aider les scientifiques à archiver et partager leurs données de manière responsable et éthique.

-

Un forum est à votre disposition pour toute question. Vous pouvez aussi nous aider à améliorer ce cours en donnant votre avis.

-

Autres suggestions